SH führt MCP-Unterstützung für KI-Integrationen ein

Alexander Stasiak

27. Nov. 2025・10 Min. Lesezeit

Inhaltsverzeichnis

1. Was MCP ist und wie es die Kommunikation zwischen AI und Tools standardisiert

MCP verstehen

Warum das wichtig ist

2. Was sich in der Praxis ändert — einfachere AI‑Anbindungen an Daten, APIs und Tools

Vor MCP vs. nach MCP

Praxisnahe Einsatzszenarien

Vergleich mit LangChain und anderen Frameworks

Wie LangFuse sich einfügt

3. MCP in Client‑Applikationen — Cybersecurity‑Beispiel aus der Praxis

Herausforderung

Lösung

Ergebnisse

4. Vorteile für Enterprises — Sicherheit, Interoperabilität und Compliance

Sicherheit

Interoperabilität und Modularität

Compliance‑Bereitschaft

Observability und operative Kontrolle

5. Wie wir unsere Kunden unterstützen

FAQ: MCP und AI‑Interoperabilität verstehen

Was ist das Model Context Protocol (MCP)?

Wodurch unterscheidet sich MCP von LangChain oder LangFuse?

Kann MCP mit jedem AI‑Modell verwendet werden?

Ist MCP produktionsreif?

Warum sollten Unternehmen MCP jetzt einführen?

Empfohlene Quellen zu MCP / AI‑Integration

Das Model Context Protocol (MCP) entwickelt sich zum USB‑C‑Port der AI‑Welt — ein universeller Standard, der intelligente Systeme nahtlos mit Tools, APIs und Daten verbindet.

Als AI Software House und vertrauenswürdiger Software Delivery Partner bringen wir vollständigen MCP‑Support in unsere Enterprise‑AI‑Lösungen — für standardisierte, sichere und skalierbare Konnektivität über Plattformen hinweg.

1. Was MCP ist und wie es die Kommunikation zwischen AI und Tools standardisiert

MCP verstehen

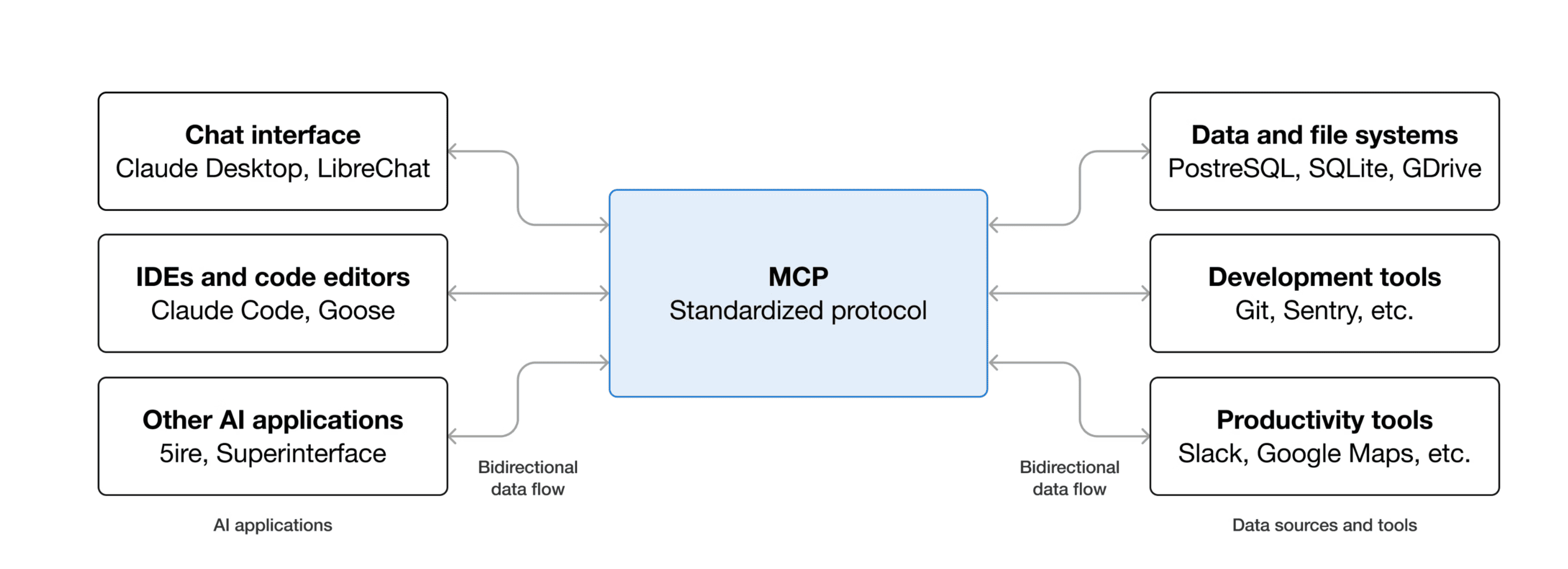

Das Model Context Protocol (MCP) ist ein offenes Protokoll, das definiert, wie AI‑Modelle Kontext, Aktionen und Ergebnisse mit externen Systemen austauschen — ob Datenbank, CRM, ERP oder eine Security‑API.

Traditionell brauchte jede Integration einen eigenen Connector oder eine Library (zum Beispiel über LangChain oder individuelles Middleware‑Code). MCP ersetzt all das durch eine gemeinsame Kommunikationsschicht — das Modell „spricht MCP“ und das System antwortet entsprechend.

Kernebenen von MCP sind:

- Context Layer – definiert die ausgetauschten Informationen (Zustand, Metadaten und Intention).

- Action Layer – legt fest, wie ein AI‑Agent Operationen aufrufen kann (read, write, execute).

- Capability Schema – macht sichtbar, was ein System kann (verfügbare Operationen, Inputs, Limits).

Diese Standardisierung macht AI‑Integrationen vorhersehbar, modular und überprüfbar — und schafft einen universellen Weg, wie intelligente Systeme mit beliebigen Enterprise‑Applikationen interagieren.

Warum das wichtig ist

- Niedrigere Integrationskosten

Statt für jede Plattform einen neuen Connector zu bauen, liefert MCP ein wiederverwendbares Protokoll, das Verbindungslogik abstrahiert.

- Modularität und Systemunabhängigkeit

Modelle oder Backend‑Tools lassen sich wechseln, ohne Adapter neu zu schreiben — die MCP‑Schnittstelle bleibt gleich.

- Deklarative Capabilities

Jedes Tool deklariert, welche Aktionen es unterstützt und unter welchen Bedingungen — ein transparenter, maschinenlesbarer Vertrag für AI‑Agents.

- Interoperabilität über Technologien hinweg

MCP ist sprachagnostisch — funktioniert in Python, Java, .NET und Node.js‑Umgebungen.

Für AI‑Verantwortliche im Enterprise‑Umfeld ist MCP nicht einfach ein weiteres Framework — es ist eine Interoperabilitätsschicht, die Integrationen zukunftssicher macht und die AI‑Einführung in komplexen Infrastrukturen beschleunigt.

2. Was sich in der Praxis ändert — einfachere AI‑Anbindungen an Daten, APIs und Tools

Vor MCP vs. nach MCP

Vorher:

Jede Integration brauchte eigene Logik. Ihr AI‑Agent benötigte Custom‑Code für Salesforce, einen anderen Adapter für SAP und noch einen für Ihre Analytics‑Schicht. Jede Änderung löste teure Updates und Regressionstests aus.

Nach MCP:

Alle diese Systeme stellen einfach MCP‑kompatible Endpoints bereit, die verfügbare Aktionen und Datentypen beschreiben.

Ihr AI‑Agent entdeckt sie automatisch, verbindet sich und führt Tasks aus — ohne handgeschriebenen Code für jedes einzelne Tool.

Praxisnahe Einsatzszenarien

- Helpdesk‑Automatisierung

Ein AI‑Assistent ruft Kundendaten aus dem CRM ab, prüft Ticketverläufe und stößt Antworten an — alles via MCP. - Enterprise Analytics

Agents können dynamisch interne Data Lakes abfragen, KPIs holen und Erkenntnisse in natürlicher Sprache zusammenfassen. - Sales‑Prozessautomatisierung

AI orchestriert mehrere APIs (Lead Scoring, CRM‑Updates, E‑Mail‑Benachrichtigungen) über standardisierte MCP‑Operationen. - Kundenportale & Wissensdatenbanken

Ein AI‑Assistent navigiert Dokumentationen, beantwortet Supportfragen und verweist auf interne Richtlinien — per MCP‑Anbindung an CMS, Dokumentenspeicher und Ticketing‑Systeme. - Community‑Plattform, integriert via MCP, kann der AI kontextrelevante Diskussionen, FAQs und Tutorials direkt für Nutzer bereitstellen — mit reduzierter Supportlast und voller Nachvollziehbarkeit der Daten.

Vergleich mit LangChain und anderen Frameworks

LangChain, LlamaIndex und ähnliche Libraries fokussieren Workflow‑Orchestrierung und Prompt‑Management.

MCP arbeitet auf einer niedrigeren, Protokoll‑Ebene — es definiert, wie AI und Tools kommunizieren, nicht wie sie programmiert werden.

Das heißt:

- Es ist framework‑agnostisch — mit jedem AI‑Stack nutzbar.

- Es reduziert Vendor Lock‑in.

- Es ermöglicht echte Interoperabilität zwischen Ökosystemen.

Kurz: MCP verschiebt das AI‑Ökosystem von fragmentierten APIs hin zu einem einheitlichen, protokollgetriebenen Gewebe.

Wie LangFuse sich einfügt

LangFuse ist eine populäre Observability‑ und Analytics‑Plattform für AI‑Applikationen — mit detailliertem Logging, Tracing und Evaluation von Prompts, Antworten und Nutzerinteraktionen.

Tatsächlich ergänzen sich MCP und LangFuse:

- MCP definiert, wie die AI Systeme verbindet.

- LangFuse trackt, was in diesen Interaktionen passiert.

In der Praxis nutzen Unternehmen MCP für standardisierte Konnektivität und LangFuse für Qualitätsmonitoring und kontinuierliche Verbesserung — Interoperabilität trifft auf Insight.

3. MCP in Client‑Applikationen — Cybersecurity‑Beispiel aus der Praxis

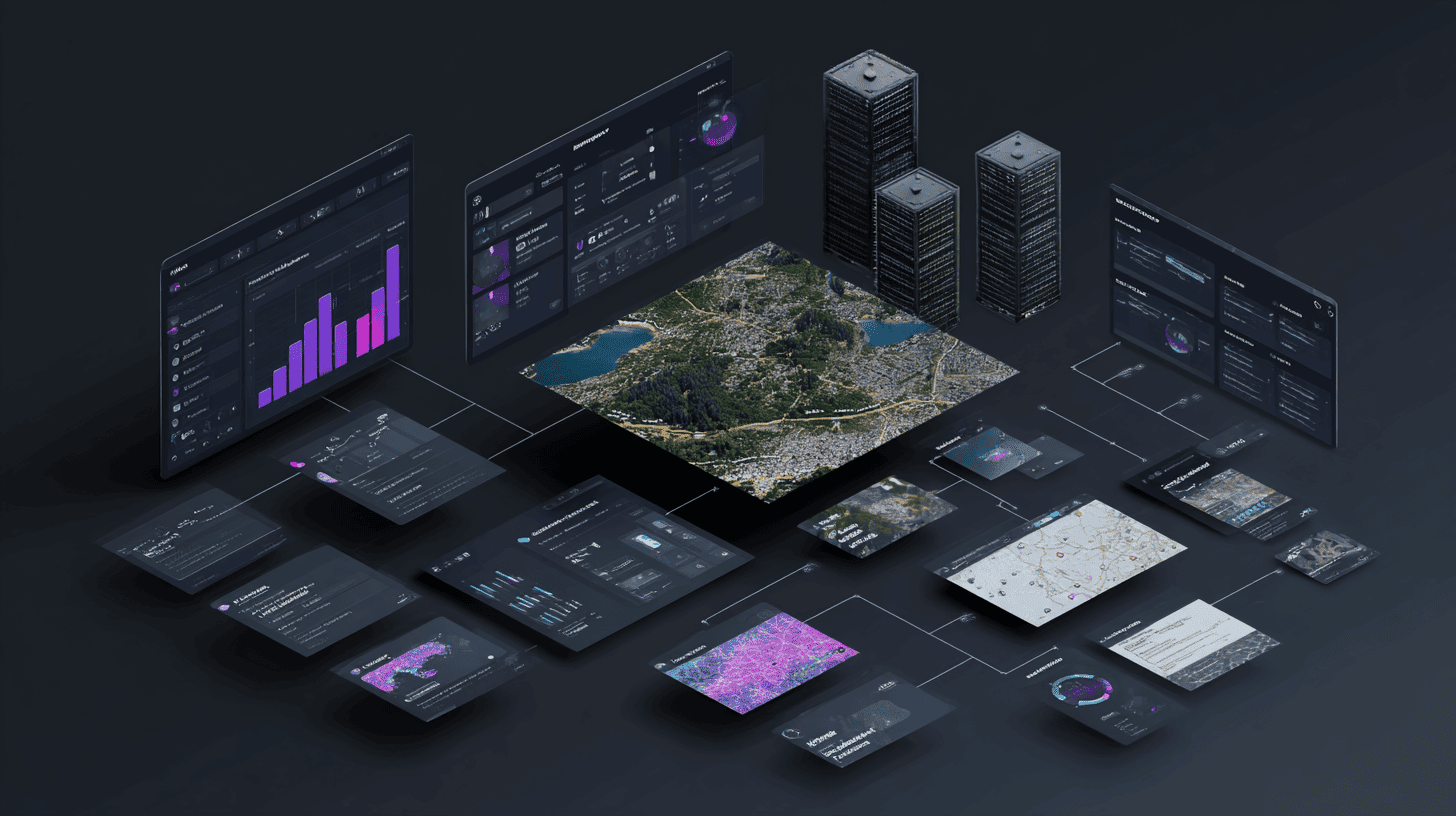

Eines unserer Schlüsselprojekte — eine Cyber Risk Mitigation Platform — zeigt, wie MCP reale Enterprise‑Umgebungen transformiert.

🔗 Zur Case Study

Herausforderung

Die Plattform vereint mehrere Komponenten:

- AI‑Module für Threat Detection und Risk Scoring.

- Integrationen mit externen Threat‑Intelligence‑APIs.

- Interne Audit‑Systeme und Compliance‑Datenbanken.

- Dashboards für Cybersecurity‑ und Compliance‑Teams.

Zuvor brauchte jedes Subsystem einen eigenen Adapter — Wartung und Upgrades waren aufwendig.

Lösung

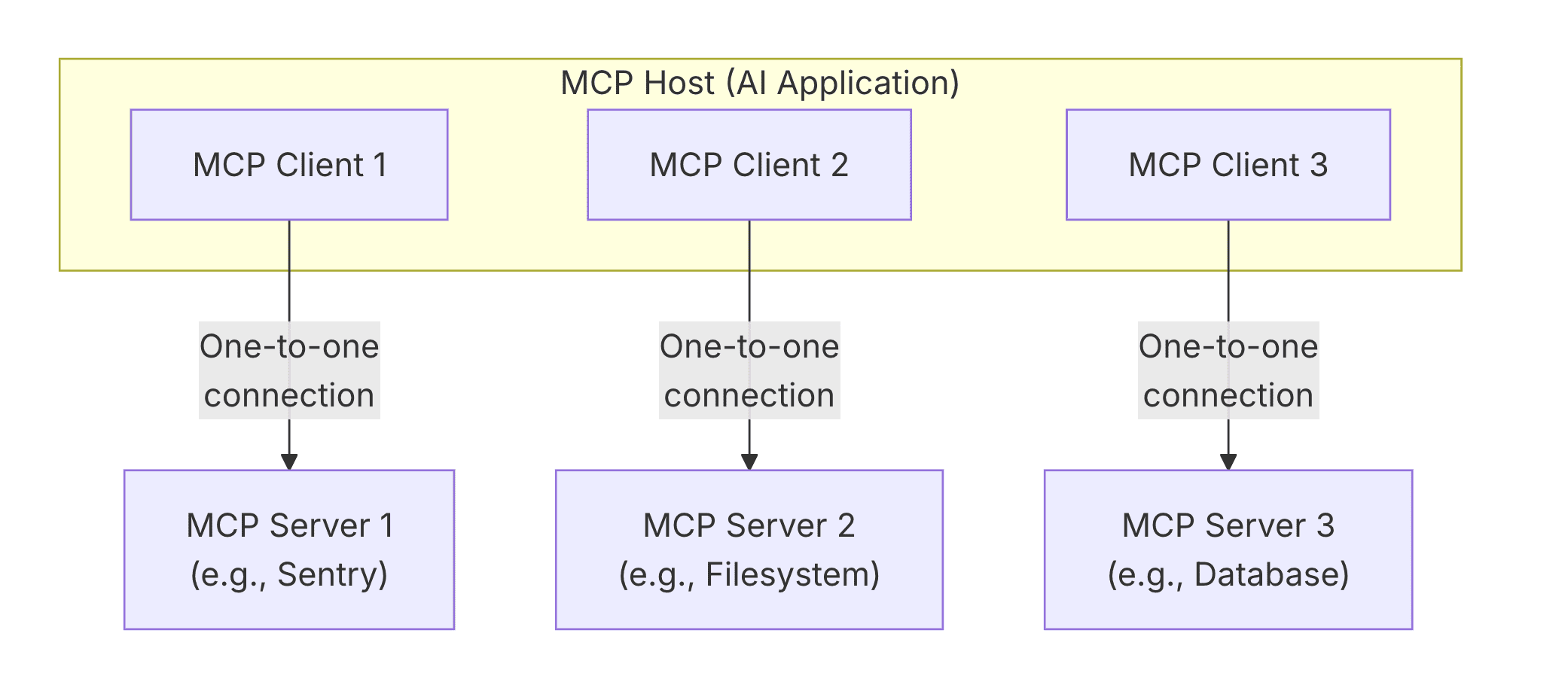

Wir implementierten MCP Gateways als Brücke zwischen AI‑Agents und allen externen APIs.

- MCP Gateway Layer

Agiert als Übersetzer — wandelt MCP‑Requests in Standard‑API‑Calls um und übernimmt Authentifizierung und Berechtigungen.

- Capability Schemas

Jede API (z. B. ein Threat‑Intelligence‑Provider) beschreibt ihre Operationen — getIndicators, queryHistory, submitReport — in einem MCP‑konformen Schema.

- Multi‑Agent AI

Das System nutzt mehrere AI‑Module (für Detection, Scoring und Reporting), die über MCP auf gemeinsame Tools zugreifen — ohne Custom‑Adapter.

- Audit Logging

Jeder MCP‑Call wird mit Kontext (Agent, Zeit, Datenumfang) aufgezeichnet — für Nachvollziehbarkeit und Accountability im Security‑Team.

Ergebnisse

- Schnellere Feature‑Rollouts — neue AI‑Funktionen verbinden sich sofort, ohne Integrations‑Overhead.

- Weniger Wartung — Tool‑Upgrades brechen bestehende Logik nicht mehr.

- Operative Transparenz — volle Nachverfolgbarkeit jeder AI‑ausgelösten Aktion.

- Verbesserte Compliance‑Position — prüfbarer, standardisierter Datenzugriff über Systeme hinweg.

So zeigen wir als AI Software House und Software Delivery Partner, wie wir mit MCP skalierbare, sichere und erweiterbare Architekturen für Enterprise‑AI liefern.

https://www.ibm.com/think/topics/model-context-protocol

4. Vorteile für Enterprises — Sicherheit, Interoperabilität und Compliance

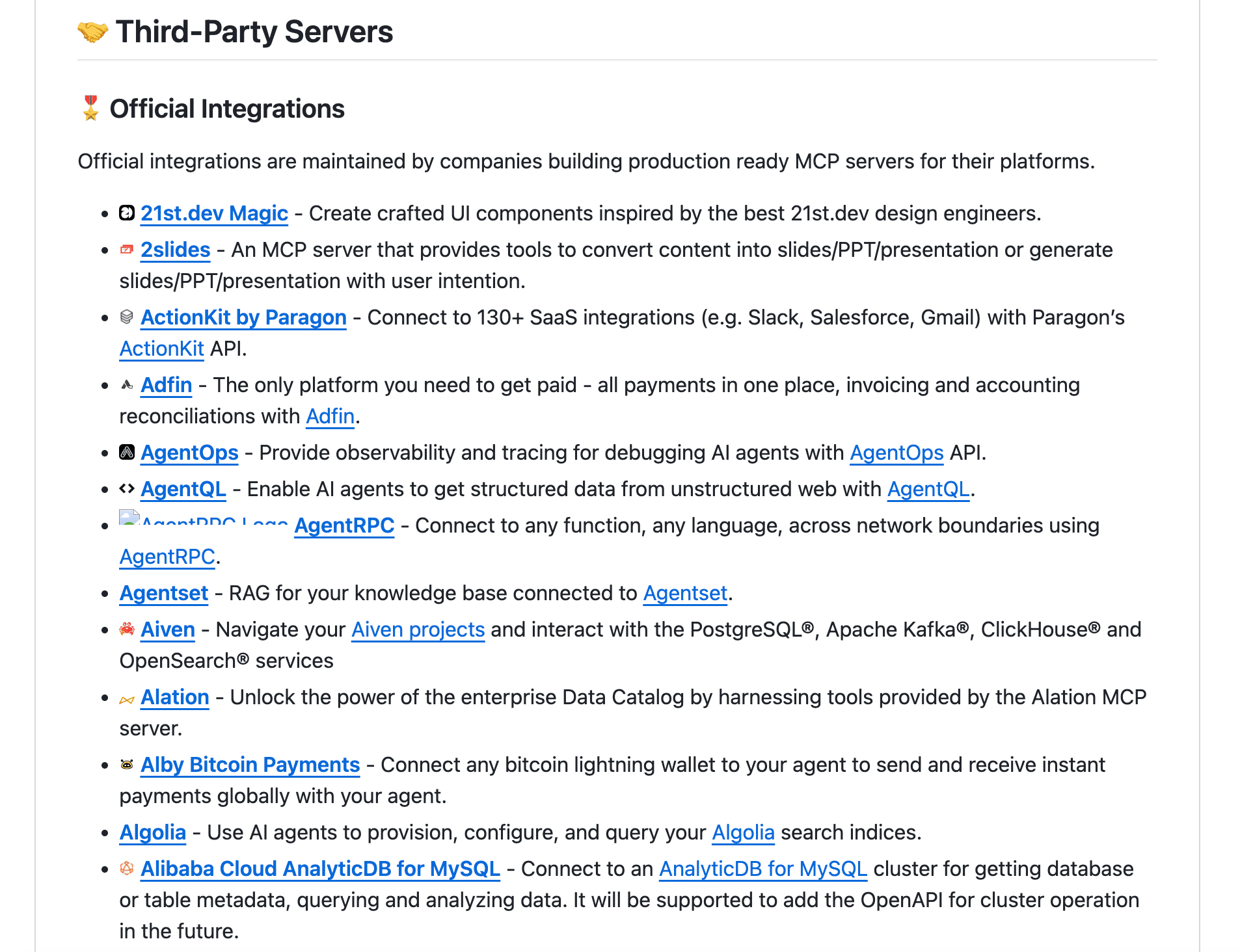

Beispielliste offizieller MCP‑Integrationen

Für Unternehmen bringt MCP messbaren Nutzen in vier Hauptbereichen:

Sicherheit

- Kontrollierter Zugriff — trennt AI‑Reasoning von Datenoperationen und minimiert unautorisierte Calls.

- Feingranulare Berechtigungen — jedes Tool deklariert erlaubte Operationen und Parameter.

- Auditierbare Spuren — jede Anfrage und Antwort kann für Forensik oder Compliance geloggt werden.

- Rate Limiting und Throttling — eingebaute Mechanismen gegen API‑Überlastung oder Missbrauch.

Interoperabilität und Modularität

- Einheitliche Kommunikation über diverse Tools — unabhängig von Sprache oder Anbieter.

- Modulare Architektur — Komponenten hinzufügen oder austauschen ohne Re‑Engineering.

- Freiheit von Vendor Lock‑in — jedes MCP‑konforme Tool wird Plug‑and‑Play.

Compliance‑Bereitschaft

Ohne sich auf bestimmte Frameworks festzulegen, passt MCP natürlich zu Datensicherheit, AI‑Governance und Privacy‑Standards wie ISO 27001 oder internen Unternehmensrichtlinien.

Da Aktionen explizit, dokumentiert und nachvollziehbar sind, vereinfacht MCP:

- Zugriffsmanagement,

- Risikomonitoring,

- Erklärbarkeit von AI‑Entscheidungen,

- Interne Audit‑Dokumentation.

So lässt sich AI sicher in regulierten oder risikosensiblen Umgebungen verankern.

Observability und operative Kontrolle

- Echtzeit‑Dashboards für alle MCP‑Calls.

- Policy‑Enforcement auf Protokoll‑Ebene (z. B. Bestätigung bei sensitiven Aktionen).

- Versionierung und Rollback‑Support für stabile API‑Evolution.

Für CTOs und Heads of AI bedeutet das: komplexe AI‑Ökosysteme werden zu beherrschbaren, transparenten Systemen mit belastbarer Datenlage.

5. Wie wir unsere Kunden unterstützen

Als Ihr AI Software House und Software Delivery Partner bieten wir:

- Architecture Audit – Identifikation von Integrations‑Bottlenecks.

- Proof of Concept (PoC) – MCP live in Ihrer Umgebung demonstrieren.

- Integration Migration – Legacy‑Connectoren in eine einheitliche Protokollschicht überführen.

- Full‑scale Deployment – produktionsreife MCP‑Gateways mit Observability.

- Training & Enablement – technische Workshops und SDK‑Onboarding.

FAQ: MCP und AI‑Interoperabilität verstehen

Was ist das Model Context Protocol (MCP)?

MCP ist ein offenes Protokoll, das standardisiert, wie AI‑Systeme mit Tools, APIs und Datenquellen kommunizieren. Es definiert eine gemeinsame Struktur für den Austausch von Aktionen, Kontext und Ergebnissen — ähnlich wie HTTP die Web‑Kommunikation standardisiert.

Wodurch unterscheidet sich MCP von LangChain oder LangFuse?

LangChain ist ein Framework für die Orchestrierung von Prompts und Workflows, während LangFuse eine Monitoring‑ und Analytics‑Plattform ist.

MCP ist hingegen ein Protokoll — es fokussiert die eigentliche Datenaustausch‑ und Interoperabilitäts‑Ebene. MCP kann neben LangChain oder LangFuse laufen und sowohl Konnektivität als auch Observability ermöglichen.

Kann MCP mit jedem AI‑Modell verwendet werden?

Ja. MCP ist modellagnostisch. Ob OpenAI, Anthropic, Gemini oder eigene LLMs — jedes Modell, das das Protokoll implementiert, kann MCP‑fähige Tools nutzen.

Ist MCP produktionsreif?

Ja. Zahlreiche AI‑Anbieter und Open‑Source‑Communities übernehmen MCP aktiv als universellen Interoperabilitätsstandard. Wir haben es erfolgreich in Enterprise‑Umgebungen mit Anforderungen an Sicherheit, Nachvollziehbarkeit und kontrollierten Datenzugriff ausgerollt.

Warum sollten Unternehmen MCP jetzt einführen?

Weil AI‑Ökosysteme zunehmend fragmentiert sind. MCP bringt Struktur, Governance und Konsistenz — essenziell für langfristige Skalierbarkeit und Compliance.

Empfohlene Quellen zu MCP / AI‑Integration

| Titel | Warum es wertvoll ist | Wichtigste Punkte / Relevanz |

| Introducing the Model Context Protocol — Anthropic | Primäre / kanonische Quelle | Offizielle Ankündigung, Designziele, SDKs, Hintergründe zu MCP. Anthropic |

| MCP Specification — modelcontextprotocol.io | Autoritative technische Spezifikation | Die detaillierte Spezifikation und Schema‑Definitionen. Model Context Protocol |

| What is MCP? — IBM | Seriöse Unternehmensperspektive | Klare allgemeinverständliche + technische Erklärung aus Sicht von IBM. IBM |

Digital Transformation Strategy for Siemens Finance

Cloud-based platform for Siemens Financial Services in Poland

Das könnte Ihnen auch gefallen...

Von der Vision zur Realität: Wie ein Proof of Concept (PoC) über den Erfolg Ihres KI-Projekts entscheidet

Die meisten KI-Projekte scheitern, bevor sie den Produktivbetrieb erreichen. Ein gut konzipierter KI-Proof of Concept (PoC) hilft Organisationen, die Machbarkeit zu validieren, Risiken zu senken und zu entscheiden, ob eine KI-Initiative weiterverfolgt werden sollte.

Alexander Stasiak

05. März 2026・16 Min. Lesezeit

Gezielt skalieren: Warum maßgeschneiderte KI-Entwicklung Standard-Tools überlegen ist

Im Jahr 2026 liegt der wahre Wettbewerbsvorteil nicht darin, einfach KI zu nutzen, sondern darin, KI einzusetzen, die genau auf Ihre Abläufe zugeschnitten ist. Standard-Tools bringen zwar schnelle Erfolge, doch maßgeschneiderte KI-Lösungen liefern die Präzision, die Integrationstiefe und den langfristigen ROI, die Sie brauchen, um Ihre Branche anzuführen.

Alexander Stasiak

15. März 2026・12 Min. Lesezeit

KI in Legacy-Systeme integrieren: Ihren Tech-Stack modernisieren, ohne bei Null anzufangen

Erfahren Sie, wie Sie Machine Learning und GenAI auf Ihre bestehenden Systeme aufsetzen, um einen 3-5-fachen ROI zu erzielen – ohne die Stabilität Ihrer Kernprozesse zu gefährden.

Alexander Stasiak

11. März 2026・15 Min. Lesezeit

Bereit, Ihr Know-how mit KI zu zentralisieren?

Beginnen Sie ein neues Kapitel im Wissensmanagement – wo der KI-Assistent zum zentralen Pfeiler Ihrer digitalen Support-Erfahrung wird.

Kostenlose Beratung buchenArbeiten Sie mit einem Team, dem erstklassige Unternehmen vertrauen.

Wir entwickeln, was als Nächstes kommt.

Dienste