Gezielt skalieren: Warum maßgeschneiderte KI-Entwicklung Standard-Tools überlegen ist

Alexander Stasiak

15. März 2026・12 Min. Lesezeit

Inhaltsverzeichnis

Maßgeschneiderte KI vs. von der Stange: der zentrale Unterschied

Wo maßgeschneiderte KI nachweislich besser performt

Beispiel: Präzision statt generischer Modelle

Skalieren mit Präzision: Architektur, Wachstum und Zuverlässigkeit

Vorher/Nachher: Skalierung mit KI von der Stange vs. maßgeschneiderter KI

Integrationstiefe: KI in realen Systemen zum Arbeiten bringen

Präzision auf Workflow-Ebene: KI im Tagesgeschäft

Sicherheit, Compliance und Datenkontrolle

Risikomanagement und Vendor Lock-in

Ökonomie und langfristiger ROI maßgeschneiderter KI

Wann sich die Investition in maßgeschneiderte KI lohnt

Den richtigen Weg wählen: von der Stange, Custom oder Hybrid

Entscheidungsrahmen: Wann auf Custom-KI setzen

Vom Konzept in die Produktion: Maßgeschneiderte KI, die wirklich skaliert

Praktische Umsetzungstipps für 2026

Fazit: Mit Präzision skalieren in der nächsten KI-Welle

Im Jahr 2026 lautet die Frage nicht mehr, ob Ihr Unternehmen KI nutzt – sondern ob Ihre KI-Nutzung einen echten Wettbewerbsvorteil schafft. Die meisten Unternehmen setzen bereits irgendeine Form von Künstlicher Intelligenz ein – von Chatbots bis zu Predictive-Analytics-Dashboards. Der entscheidende Unterschied ist jedoch: Die Unternehmen, die davonzuziehen beginnen, nutzen nicht einfach nur KI. Sie nutzen KI, die genau auf ihre Betriebsweise zugeschnitten ist.

Maßgeschneiderte KI schlägt Standardtools von der Stange konsistent dort, wo Präzision, Skalierbarkeit und Compliance-Fähigkeit gefragt sind. Bis 2025–2026 verwenden über 75–80 % der Mid-Market- und Enterprise-Unternehmen mindestens ein KI-Tool, doch weniger als 25 % berichten über messbare Wettbewerbsvorteile ausschließlich durch Lösungen von der Stange. Die Lücke entsteht nicht durch Technologiezugang – sondern durch technologischen Fit.

KI von der Stange ist hervorragend für Quick Wins: einen Chatbot aufsetzen, einfache Dokumentenprozesse automatisieren oder KI-gestützte Suche in eine Knowledge Base integrieren. Diese Tools sind in Tagen, manchmal Stunden, einsatzbereit. Der langfristige Wert über 12–36 Monate entsteht jedoch durch maßgeschneiderte KI. Wenn Sie Modelle auf Ihren proprietären Daten trainieren, tief in Ihre Workflows integrieren und exakt auf Ihre KPIs feinabstimmen, bauen Sie etwas, das Wettbewerber nicht einfach von einem Anbieter kaufen können.

Dieser Artikel zeigt, wo maßgeschneiderte KI klar besser performt, wie sie skaliert, ohne Präzision zu verlieren, welche Auswirkungen das auf Sicherheit und Compliance hat und wann sich der Eigenbau wirtschaftlich wirklich lohnt. Wenn Sie Ihre KI-Strategie für die nächste Wachstumsphase evaluieren, ist dies der Rahmen, den Sie brauchen.

Maßgeschneiderte KI vs. von der Stange: der zentrale Unterschied

Bevor wir Performance vergleichen, klären wir die Begriffe. „Off the shelf“ und „custom“ werden in Pitches und Strategie-Meetings oft genutzt, doch die praktischen Unterschiede zählen mehr als Marketing.

KI von der Stange meint vorgefertigte Plattformen für breite Einsatzfälle. Denken Sie an ChatGPT API, Salesforce Einstein, HubSpot AI, Microsoft Copilot oder Google Cloud AI Services. Diese Lösungen sind für schnelle Rollouts über Tausende Organisationen ausgelegt. Sie bedienen gängige Anwendungsfälle gut – Kundenservice-Automatisierung, E-Mail-Entwürfe, Basis-Analytik –, da sie auf allgemeinen Datensätzen trainiert und für den Massenmarkt optimiert sind. Man meldet sich an, verbindet Daten und startet innerhalb weniger Tage.

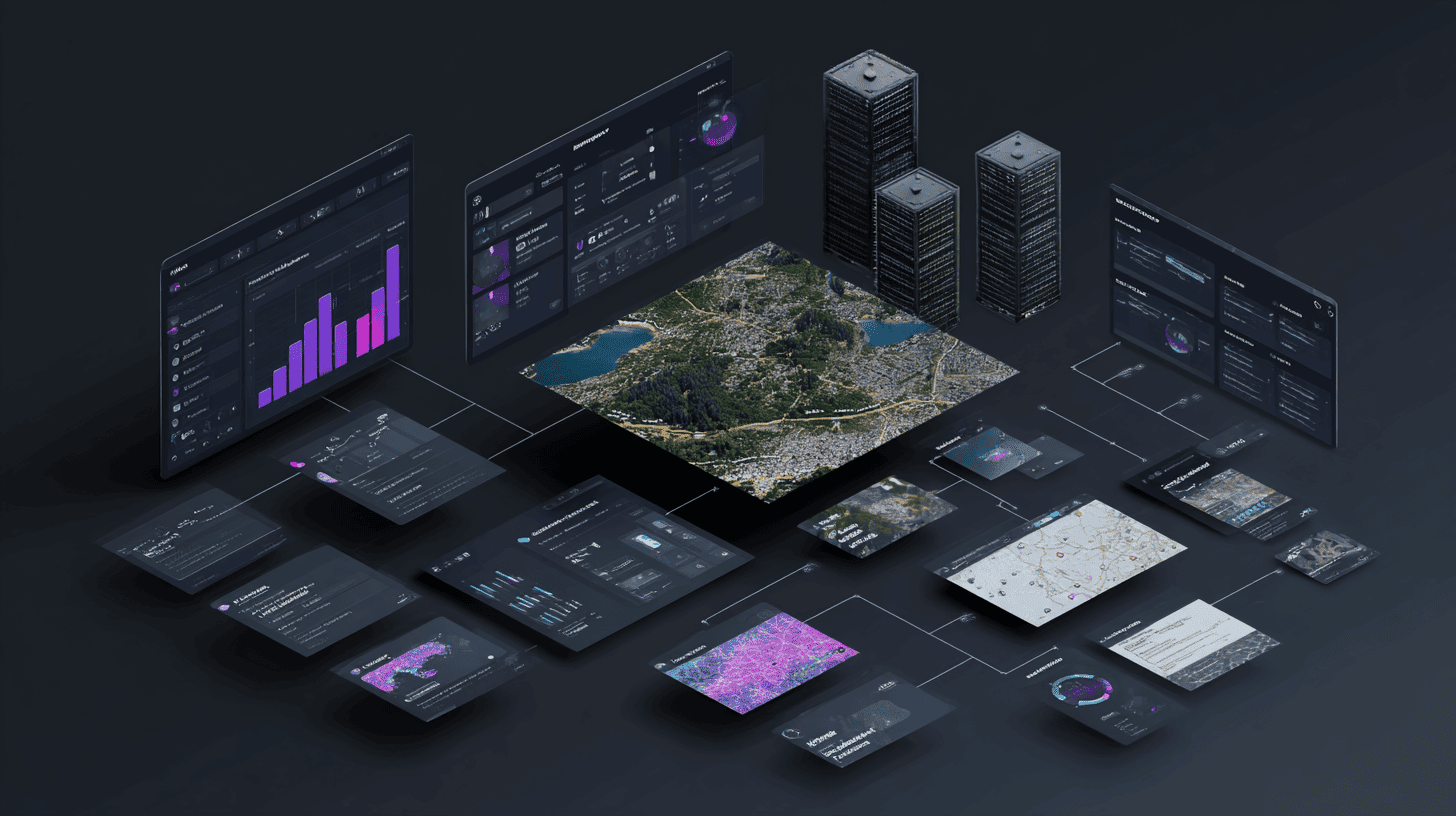

Maßgeschneiderte KI-Lösungen werden hingegen um die spezifischen Daten, Workflows, Risikoprofile und Wachstumsziele einer Organisation herum entwickelt. Eine Custom-Lösung kann Fine-Tuning von Foundation Models auf Ihren Transaktionsdaten, Retrieval-Augmented Generation (RAG) auf Ihren internen Wissensbasen oder Klassifikatoren auf Basis Ihrer historischen Entscheidungen umfassen. Die Architektur spiegelt Ihr Geschäft wider – nicht die Annahmen eines Anbieters über „die meisten Unternehmen“.

Der fundamentale Unterschied: Tools von der Stange zwingen das Geschäft, sich den Fähigkeiten und Grenzen des Tools anzupassen. Maßgeschneiderte KI passt sich dem Geschäft an – und entwickelt sich mit, wenn das Unternehmen skaliert, neue Märkte betritt oder neuen Regularien unterliegt.

Praktische Implikationen: Bei Plattformen von der Stange liegt das IP beim Anbieter – Sie lizenzieren Fähigkeiten, bauen aber keine Assets auf. Datenresidenz hängt von der Infrastruktur des Anbieters ab; Ihre Optionen, wo Daten liegen und wie sie verarbeitet werden, sind begrenzt. Die Roadmap steuert der Anbieter anhand aggregierter Nachfrage – oft nicht deckungsgleich mit Ihren Prioritäten. Langfristige Flexibilität wird durch die nächsten Produktschritte des Anbieters limitiert.

Bei Custom-Entwicklung besitzen Sie die Modelle, Trainingsdaten-Pipelines und die Inference-Infrastruktur. Sie wählen Deployments gemäß Ihren Compliance-Anforderungen. Ihre Roadmap folgt Ihren strategischen Zielen. Und Sie behalten die Flexibilität, Komponenten auszutauschen oder Provider zu migrieren, wenn sich Bedürfnisse ändern.

Zwischen 2023 und 2026 sanken Kosten und Komplexität für Custom-KI deutlich. Open-Source-Foundation-Models wie Llama und Mistral reduzieren den Bedarf, von Grund auf zu trainieren. Cloud-native MLOps-Plattformen vereinfachen Deployment und Monitoring. Wiederverwendbare Bausteine – Vector Databases, Feature Stores, Evaluationsframeworks – beschleunigen Entwicklung. Was früher ein dediziertes KI-Forschungsteam brauchte, liegt heute in Reichweite fähiger Engineering- und Data-Science-Teams.

Wo maßgeschneiderte KI nachweislich besser performt

Enterprise-KI-Performance bedeutet nicht nur Genauigkeit auf Benchmarks. Es geht um Latenz unter echter Last, Workflow-Fit, der Adoption treibt, Zuverlässigkeit im Scale – und am Ende um Business-Resultate. Generische Tools optimieren für Durchschnittsfälle. Maßgeschneiderte Modelle optimieren für Ihre Fälle.

Wenn Sie Modelle auf proprietären Daten trainieren – fünf bis zehn Jahre Transaktionslogs, Sensorströme, Kundeninteraktionen oder interne Dokumente –, übertreffen Sie generische Modelle regelmäßig um zweistellige Prozentpunkte bei Genauigkeit und Relevanz. Das ist nicht theoretisch. Ein Logistiker, der ein Routing-Modell auf Lieferdaten 2018–2025 inklusive Verkehrsmustern, Fahrerleistung und regionalen Ausnahmen trainierte, verbesserte die pünktliche Zustellung um ca. 20–30 % über eine generische Routing-API hinaus. Die generische API weiß nicht, dass Ihr größtes Verteilzentrum jeden Dienstag ein Ladezonen-Engpass ist – oder dass bestimmte Fahrer in manchen Vierteln konstant besser liefern.

Geschäftsspezifische Optimierung heißt, auf domänenspezifische Metriken zu tunen, die zählen: Genehmigungsgenauigkeit in Claims, Vorhersage von Wartungsvorlaufzeiten, Underwriting-Schwellen, Lagerumschlag. Data Scientists in Custom-Projekten können exakte Trade-offs codieren – etwa etwas höhere False Positives akzeptieren, um teure False Negatives zu vermeiden –, was Tools von der Stange selten leisten.

Maßgeschneiderte KI lässt sich auch auf spezifische Infrastruktur-Anforderungen optimieren. Müssen Modelle auf Edge-Geräten in Werken laufen, auf On-Premises-GPU-Clustern unter strikten Datenresidenzgesetzen oder für bestimmte Cloud-Setups? Custom-Entwicklung gibt Ihnen diese Kontrolle. Ergebnis sind häufig geringere Inference-Kosten und schnellere Antwortzeiten, statt jeden Request durch eine Multi-Tenant-SaaS-API zu leiten.

In komplexen Entscheidungsdomänen – Healthcare-Triage, industrielle Qualitätskontrolle, Finanzrisiko-Scoring, Fraud Detection – schafft die Fähigkeit, Domänenregeln und Schwellen zu kodieren, klare Vorteile. Sie bauen Modelle, die nicht nur vorhersagen, sondern harte Constraints, Eskalationsregeln und regulatorische Anforderungen respektieren, die generischen Tools unbekannt sind.

Beispiel: Präzision statt generischer Modelle

Ein mittelständischer europäischer Hersteller betreibt 12 Fertigungslinien an drei Standorten. 2024 nutzte er eine generische Predictive-Maintenance-API – ein renommiertes Tool von der Stange, das ungeplante Ausfälle über Ausfallprognosen reduzieren sollte.

Die Ergebnisse waren ernüchternd. Das generische Modell erzeugte Alarme, aber etwa die Hälfte waren Fehlalarme. Die Instandhaltung wurde skeptisch und ignorierte Vorhersagen. Das Tool unterschied nicht zwischen normalen saisonalen Schwankungen und echter Degradation.

Anfang 2025 wechselte das Unternehmen zu einem Custom-Modell, trainiert auf sieben Jahren Sensorsignalen je Linie. Das Modell berücksichtigte Anlagentyp, saisonale Nutzung, Chargen-Metadaten von Zulieferern und historische Reparaturnotizen der Techniker. Generische Tools konnten diese Kontexte nicht aufnehmen oder deuten.

Das Ergebnis: Fehlalarme sanken um 45 %, echte Ausfälle wurden 28 % besser erkannt, und das Vertrauen – und damit die Befolgung der Empfehlungen – stieg deutlich. Der Business-Impact war greifbar: weniger Notabschaltungen, geringere Ersatzteilbestände, planbarere Personaleinsätze und rund 2,3 Mio. US‑Dollar jährliche Einsparungen. Das System amortisierte sich in neun Monaten.

Skalieren mit Präzision: Architektur, Wachstum und Zuverlässigkeit

„Mit Präzision skalieren“ heißt, Nutzer, Datenvolumen und Use Cases zu vergrößern, ohne Genauigkeit, Governance oder Kostenkontrolle zu verlieren. Etwas zu skalieren, das schlecht funktioniert, ist leicht. Die Kunst ist, Performance bei wachsender Komplexität zu halten – oder zu steigern.

Tools von der Stange stoßen beim Skalieren vorhersehbar an Grenzen. Subskriptionsstufen deckeln Nutzung und erzwingen teure Upgrades oder Overages. API-Rate-Limits drosseln in Peaks. Rigid Feature-Sets decken neue Use Cases nicht ab. Auf geteilter Multi-Tenant-Infrastruktur hängt Ihre Performance teils vom Verhalten anderer Kunden ab.

Maßgeschneiderte KI auf AWS, Azure oder GCP funktioniert anders. Mit containerisierten Microservices und Autoscaling lassen sich Komponenten unabhängig skalieren. Dateningest verarbeitet Schübe bei Batch-Imports. Feature-Berechnung parallelisiert auf größere Cluster beim Retraining. Model Serving skaliert horizontal für Inference-Spitzen. Analytics und Monitoring laufen auf separaten Ressourcen. Ihre Kosten korrelieren eng mit dem tatsächlich gelieferten Wert, nicht mit arbiträren Tiers.

Ein regionaler Retailer, der zwischen 2022 und 2025 von 50 auf 300 Filialen wuchs, zeigt das: Sein Demand-Forecasting-Modell – maßgeschneidert auf historische Verkäufe, regionale Demografie und Promotion-Kalender – bewältigte das 5–6-fache Datenwachstum ohne Re-Plattforming. Neue Store-Formate, Kategorien, Geografien kamen hinzu. Das Modell entwickelte sich mit, weil die Architektur auf Erweiterbarkeit ausgelegt war – nicht nur auf Erstdeployment.

Präzises Skalieren umfasst auch Governance. Custom-Systeme integrieren versionierte Modelle mit vollständiger Lineage, detaillierte Audit-Logs pro Prediction, rollenbasierte Zugriffe und reproduzierbare Experimente für Prüfungen. Viele Organisationen stellen fest, dass diese Fähigkeiten bei Tools von der Stange intransparent oder nicht verfügbar sind – problematisch, wenn Auditoren Fragen stellen.

Mit maßgeschneiderter KI können Sie proaktiv für künftige Use Cases designen: neue Regionen mit anderen Datenresidenzvorgaben, neue Produktlinien mit eigenen Vorhersageanforderungen, zusätzliche Kanäle wie Mobile oder Voice. Sie warten nicht auf die Roadmap eines Anbieters.

Vorher/Nachher: Skalierung mit KI von der Stange vs. maßgeschneiderter KI

Ein europäisches Fintech, aktiv in mehreren Märkten, lernte das aus Erfahrung. Ende 2024 liefen die Fraud-Detection-Modelle auf einer prominenten Plattform von der Stange. Mit der Expansion in drei neue Märkte traten Probleme auf.

Vor dem Wechsel verursachte API-Throttling spürbare Verzögerungen bei Peak-Volumina. Regionale Rechenzentren für DSGVO-Compliance waren nicht in allen Zielmärkten verfügbar. Mehrsprachige Transaktionsbeschreibungen erhöhten die False-Positive-Rate in Nicht-Englisch-Märkten. Jeder Workaround – Batching, zusätzliche Vorverarbeitung, manuelle Review-Queues – erhöhte Latenz und Kosten.

Nach dem Aufbau eines Custom-Fraud-Stacks Anfang 2025 änderte sich das Bild. Eine modulare Architektur trennte Feature Stores, Embedding-Berechnung und Model Inference in eigenständige Services. Jede Komponente skalierte nach echter Last. Regionale Deployments erfüllten Datenresidenz-Anforderungen ohne Kunstgriffe. Maßgeschneiderte NLP-Vorverarbeitung handhabte Mehrsprachigkeit nativ – nicht als nachgelagerter Hack.

Die Ergebnisse: 3,5× Nutzervolumen ohne Latenzeinbruch, stabile Antwortzeiten in Peaks inklusive Black Friday 2025, Inference-Kosten um 40 % gesenkt und verbesserte Uptime-SLAs, die anspruchsvolle Unternehmenskunden zufriedenstellten.

Integrationstiefe: KI in realen Systemen zum Arbeiten bringen

Ein wiederkehrendes Muster: Ein KI-Tool wird ausgerollt, die Demos wirken gut – sechs Monate später stagniert die Nutzung. Die Vorhersagen sind okay, aber niemand nutzt sie, weil sie nicht in die reale Arbeit passen.

Wert entsteht, wenn KI nahtlos in bestehende Systeme eingebettet ist – ERP, CRM, EHR, WMS, individuelle LOB-Apps – statt als separates „KI-Portal“, das Kontextwechsel, Copy-Paste und manuelle Umsetzung verlangt.

Tools von der Stange integrieren meist über limitierte Konnektoren oder generische APIs. Man exportiert Daten, lässt sie durch den KI-Service laufen und importiert Ergebnisse. Oder man baut ein zusätzliches Interface neben dem Primär-Workflow. Das reicht für einfache Fälle, erzeugt im Scale aber Reibung: manuelle Workarounds, Batch-Exporte, doppelte Dateneingaben, UI-Brüche.

Custom-Entwicklung ermöglicht Integration in Architekturtiefe. Event-getriebene Architekturen triggern Vorhersagen bei spezifischen Business-Events. Streaming-Pipelines verarbeiten Daten in Echtzeit statt in Batches. Custom-APIs passen exakt zu internen Datenmodellen, Sicherheitskontrollen und Freigabe-Workflows.

Ein B2B-SaaS-Anbieter brauchte Produktempfehlungen für sein Sales-Team. Er integrierte eine maßgeschneiderte Recommendation Engine direkt in den React-Frontend- und PostgreSQL-Backend-Stack. Predictions erschienen inline – direkt im gewohnten Sales-Workflow, nicht in einem separaten Dashboard. Das System respektierte dieselbe Authentifizierung, Berechtigungen und Audit-Logs wie alle anderen Features. Die Adoption war sofort da, weil es nichts Neues zu lernen gab – die KI machte den bestehenden Prozess einfach smarter.

In Finanzwesen, Gesundheit und öffentlicher Hand ist diese Integrationstiefe Pflicht. Seit 2024 brauchen regulierte Branchen KI, die bestehende Freigaben respektiert, rollenbasierten Zugriff wahrt und Audit-Trails für Compliance erzeugt. Das von Grund auf zu bauen ist anspruchsvoll; es nachträglich auf Tools von der Stange zu stülpen, oft unmöglich.

Engere Integration führt in der Regel zu höherer Nutzung und schnellerem Time-to-Value. Nutzer müssen keine neuen Tools lernen oder Workflows ändern. Die KI verbessert einfach, was schon da ist.

Präzision auf Workflow-Ebene: KI im Tagesgeschäft

Die wahre Stärke maßgeschneiderter KI zeigt sich auf Workflow-Ebene – getriggert durch interne Events, eingebettet in bestehende Tools, mit Reaktionszeiten in Millisekunden statt Batch-Verarbeitung.

Ein Support-Team mit Tausenden Tickets täglich könnte mit einem generischen Tool Tickets periodisch exportieren, klassifizieren lassen und zurückspielen. Verzögerung und manuelle Schritte bedeuten: Klassifizierungen kommen, wenn Agenten schon arbeiten – wenig Nutzen.

Ein Custom-Klassifikationsmodell hingegen taggt und routet Tickets automatisch in unter 200 Millisekunden – direkt in der bestehenden Helpdesk-UI. Beim Eintreffen wird ein Ticket klassifiziert und zugewiesen, bevor ein Mensch es sieht. Der Agent öffnet eine vorpriorisierte Queue mit relevantem Kontext.

Dieser eingebettete Ansatz minimiert Kontextwechsel – Agenten bleiben in einem Tool. Er reduziert Trainingsaufwand, weil KI bekannte Interfaces ergänzt statt ersetzt. Und er schafft Vertrauen, weil Vorhersagen im gewohnten Prozess erscheinen – nicht als externe Empfehlungen.

Zusätzlich entsteht Feedback: Feingranulare Telemetrie – Klicks auf Vorschläge, Agenten-Overrides, Korrekturmuster – fließt direkt in Retraining-Loops. Das System verbessert sich kontinuierlich anhand realer Nutzung, nicht abstrakter Benchmarks.

Sicherheit, Compliance und Datenkontrolle

Zwischen 2023 und 2026 wandelte Regulatorik die Sicht auf KI-Deployments. DSGVO-Durchsetzung zog an. CCPA weitete sich aus. HIPAA-Audits prüften KI-gestützte klinische Entscheidungen. Der EU AI Act brachte neue Anforderungen für Hochrisiko-Systeme. Branchenspezifische Leitlinien entstanden für Finanzdienste, Gesundheit und kritische Infrastruktur.

In diesem Umfeld sind Datensicherheit und Auditierbarkeit Kernanforderungen – nicht „Nice-to-haves“, sondern KO-Kriterien.

Tools von der Stange verarbeiten Daten oft auf Anbieter-Infrastruktur – mit Optionen für Datenresidenz, Verschlüsselung und Aufbewahrung, die durch den Anbieter vorgegeben sind. Für sensible Daten ist das riskant. Wo genau liegen Ihre Daten? Wer hat Zugriff? Wie lange werden sie aufbewahrt? Was passiert im Sicherheitsvorfall? Die Antworten hängen von Policies und Infrastrukturentscheidungen ab, die Sie nicht kontrollieren.

Mit Custom-KI wählen Organisationen Deployments passend zur Compliance: Private VPCs auf AWS oder Azure halten Daten in kontrollierten Grenzen. On-Premises-Cluster erfüllen strengste Lokalitätsanforderungen. Sovereign Clouds adressieren nationale Residenzvorgaben. Sie kontrollieren Schlüssel, Zugriffsprotokolle und Aufbewahrungsfristen auf Architekturebene.

Custom-Entwicklung erlaubt auch, Compliance-Regeln im Design zu verankern. PII wird maskiert oder redigiert, bevor Trainingsdaten die Pipeline erreichen. Bestimmte Feature-Kombinationen mit Bias- oder Privacy-Risiken werden programmatisch unterbunden. Einwilligungen werden beim Datensammeln nachverfolgt. Explizite Audit-Trails dokumentieren jede Prediction, jede Modellversion, jedes Access-Event.

Ein Healthcare-Verbund 2024 ist ein Beispiel. Er rollte ein Custom-Clinical-Decision-Support-Modell für Triage in einer HIPAA-konformen Umgebung aus. PHI-De-Identifizierung griff automatisch, bevor Daten das Modell erreichten. Zugriffskontrollen stellten sicher, dass nur autorisiertes Klinikpersonal Vorhersagen sah. Audit-Logs hielten Prüfungen stand. Diese Governance per Konfiguration in einer generischen Multi-Tenant-KI-SaaS zu erreichen, wäre äußerst schwierig gewesen.

Risikomanagement und Vendor Lock-in

Datensicherheit umfasst mehr als die Vermeidung von Breaches. Dazu zählt auch strategisches Risiko: Abhängigkeit von Preisentscheidungen, Modell-Roadmaps und SLAs eines einzelnen Vendors.

Viele Organisationen erlebten 2024–2025, wie große KI-Anbieter Preise anpassten, APIs abkündigten oder Nutzungsbedingungen kurzfristig änderten. Wer Kernprozesse um eine spezifische API gebaut hatte, stand plötzlich vor unplanbaren Mehrkosten oder Migrationsdruck.

Custom-KI – besonders auf Open-Source-Frameworks und containerisierten Deployments – reduziert Lock-in signifikant. Müssen Sie von AWS zu Azure, von Cloud zu On-Prem oder von einem Foundation Model auf ein anderes wechseln, haben Sie diese Option. Ihre Modelle, Datenpipelines und Serving-Infrastruktur sind über 3–5 Jahre portabel.

Rechtsabteilungen größerer Unternehmen werten Anbieterabhängigkeit zunehmend als Einkaufsrisiko. Custom-Entwicklung erfordert zwar mehr Vorabinvest, verschafft aber Verhandlungsmacht und strategische Optionalität, die reines SaaS nicht bietet.

Custom-KI ermöglicht zudem Defense-in-Depth: Netzwerkkontrollen auf Infrastrukturebene, Identity & Access Management auf Plattformeebene sowie Modellschutz wie Red-Teaming, adversarielle Tests und Monitoring gegen Data Poisoning oder Model Extraction. Sie setzen Sicherheitsmaßnahmen passend zu Ihrem Risikoprofil um – nicht nur das, was ein Anbieter anbietet.

Ökonomie und langfristiger ROI maßgeschneiderter KI

Der reine Listenpreisvergleich – Monatsabo vs. Projektkosten – führt bei KI-Investitionen in die Irre. Maßgeblich sind Total Cost of Ownership (TCO) über 24–36 Monate und der erzeugte strategische Wert.

Tools von der Stange haben geringe Anlaufkosten. Man zahlt monatlich oder nutzungsbasiert – zunächst überschaubar. Doch diese Kosten kumulieren. Mit wachsender Nutzung – mehr User, mehr API-Calls, mehr Use Cases – steigen variable SaaS-Kosten stark. Organisationen, die 2024 monatlich 8.000–12.000 US‑Dollar für KI-APIs ausgaben, sahen sich 2026 mit 25.000–40.000 US‑Dollar konfrontiert, als die Nutzung unternehmensweit wuchs.

Custom-KI hat ein anderes Kostenprofil. Höhere Anlaufkosten – von ca. 200.000 US‑Dollar für fokussierte Lösungen bis zu mehreren Millionen für Enterprise-Plattformen. Laufende Kosten sind primär Wartung und Infrastruktur, typischerweise 15–25 % der initialen Baukosten jährlich. Es fallen keine nutzungsbasierten Gebühren an.

Der Break-even hängt vom Scale ab. Bei hohen Transaktionsvolumina, häufiger Modellausführung in Kern-Workflows oder mehreren Use Cases (die jeweils eigene Abos erforderten) senkt Custom-KI den TCO oft binnen 18–24 Monaten. Dasselbe Unternehmen, das 8.000–12.000 US‑Dollar monatlich für Vendor-APIs ausgibt, kommt mit einem eigenen Inference-Stack auf 3.000–4.000 US‑Dollar – bei höherer Genauigkeit und voller Infrastrukturkontrolle.

Über direkte Kosten hinaus zählen weniger offensichtliche ROI-Faktoren:

- Weniger manuelle Arbeit durch präzisere Vorhersagen

- Bessere Entscheidungen dank Modelle, die Ihren Kontext wirklich abbilden

- Weniger Compliance-Vorfälle durch eingebaute Governance

- Höhere Kundenbindung durch individuellere Erlebnisse

- Neue Umsatzströme durch proprietäre KI-Fähigkeiten, die Wettbewerber nicht kopieren können

Der Besitz des IP – Modelle, Datenassets, Pipelines – erhöht zudem den Bilanzwert. Für Startups und Scale-ups mit Finanzierungs- oder Exit-Plänen sind proprietäre KI-Fähigkeiten verteidigbare Assets, die Bewertungen beeinflussen.

Wann sich die Investition in maßgeschneiderte KI lohnt

Custom-KI ist nicht immer die richtige Wahl. Die Investition rechnet sich unter bestimmten Bedingungen:

Hohe Transaktionsvolumina: Bei Tausenden oder Millionen Predictions täglich wird Preis-pro-Call teuer. Eigene Infrastruktur amortisiert sich im Scale besser.

Wiederholte Modellausführung in Kern-Workflows: Beeinflussen KI-Predictions direkt Umsatz oder Kosten – Pricing, Underwriting, Routing, Bestandsmanagement –, übersetzen sich Präzisionsgewinne direkt in Business-Impact.

Strenge Regulatorik: Wenn Compliance spezifische Datenresidenz, Audits oder Governance verlangt, ist Eigenbau oft einfacher, als generische Tools hinzubiegen.

Einzigartige Daten-Assets: Verfügen Sie über Daten, auf die Wettbewerber keinen Zugriff haben – proprietäre Transaktionsdaten, Sensorsignale Ihrer Anlagen, historische Expertenentscheidungen –, liefern Custom-Modelle Differenzierung, die Tools von der Stange nicht replizieren.

Bewerten Sie Investitionen mit 3- und 5-Jahres-TCO-Szenarien: fortgesetzter Einsatz von Tools von der Stange vs. gestufter Eigenbau. Jahr 1 kann ein fokussiertes Pilotprojekt für einen High-Impact-Use-Case sein. Jahre 2 und 3 rollen breiter aus; frühe Einsparungen finanzieren den Ausbau.

Oft startet man mit einem einzelnen, wirkungsvollen Custom-Use-Case – Claims-Triage, Pricing Engine, Supply-Chain-Optimierung –, weist binnen 6–12 Monaten Wert nach und reinvestiert Ersparnisse in weitere Custom-KI. Ab dem ersten Nachweis finanziert sich das Muster selbst.

Für CFOs und COOs gilt: Quantifizieren Sie nicht nur Kostensenkungen, sondern auch Umsatz- oder Margen-Hebung. 2–3 % Conversion-Uplift oder 5–10 % weniger Churn durch bessere KI-Präzision übersteigen häufig die Implementierungskosten. Fokussieren Sie auf messbare Metriken, prognostizierbare Einsparungen und risikoadjustierte Renditen – nicht auf theoretische Modellwerte.

Den richtigen Weg wählen: von der Stange, Custom oder Hybrid

Das Ziel ist nicht „überall Custom“. Nutzen Sie je Ebene das passende Werkzeug: Commodity-Funktionen, wo Differenzierung egal ist; maßgeschneiderte Lösungen, wo Präzision Wettbewerbsvorteile schafft.

KI von der Stange ist ideal für standardisierte Funktionen: generische Chatbots für Routineanfragen, Office-Produktivität wie E-Mail-Entwürfe oder Meeting-Zusammenfassungen, Basis-Analytics und Reporting. Diese Fähigkeiten sind ausgereift, gut verstanden und differenzieren selten. Für kleine Teams, frühe Phasen oder Fälle, in denen Time-to-Deploy zählt, sind vorkonfigurierte KI-Tools sinnvoll.

Maßgeschneiderte KI lohnt, wo Präzision, Compliance oder Verteidigbarkeit echten Business-Wert erzeugen: Underwriting-Modelle, die Ihre Risikoneigung und Schadenhistorie reflektieren. Dynamische Pricing-Engines, abgestimmt auf Ihr Marktumfeld. Fertigungs-Yield-Optimierung auf Basis Ihrer Anlagen und Prozesse. Fraud-Detection-Modelle, trainiert auf Ihren Transaktionsdaten und Fraud-Mustern.

Dazwischen liegt der Hybrid-Ansatz, den viele bevorzugen. Nutzen Sie Foundation Models – GPT-4, Claude, Llama – als Bausteine in Custom-Pipelines. Umhüllen Sie Vendor-APIs mit proprietärer Logik, eigener Vorverarbeitung und privater Datenabfrage. Ergänzen Sie domänenspezifisches Fine-Tuning. So erreichen Sie 70–80 % der Präzisionsvorteile von Custom bei 40–50 % weniger Entwicklungszeit.

Zwischen 2024 und 2026 wechselten erfolgreiche Unternehmen vom „Tool-Shopping“ zu KI-Roadmaps mit gestaffelten Investments. Sie starten mit Tools von der Stange, um Use Cases zu validieren und Fähigkeiten aufzubauen. Danach identifizieren sie Lücken – Performance, Integration, Compliance –, die gezielte Custom-Investments rechtfertigen. Das Portfolio entwickelt sich evidenzbasiert, nicht nach Vendor-Marketing.

Betrachten Sie Ihre KI-Bedürfnisse als Portfolio. Manche deckt man mit bewährten Standardlösungen. Manche erfordern einzigartige Fähigkeiten. Manche profitieren von Kombinationen. Der richtige Mix hängt von Time-to-Value, strategischer Relevanz und regulatorischer Last ab.

Entscheidungsrahmen: Wann auf Custom-KI setzen

Prüfen Sie für jeden Use Case diese Fragen:

Ist dieser Prozess zentral für unsere Differenzierung? Wenn Wettbewerber mit demselben Tool von der Stange dieselben Ergebnisse erzielen, bauen Sie keinen Vorteil auf. Beeinflusst der Prozess jedoch Kundenerlebnis, Preissetzung oder Effizienz in unterscheidender Weise, ist Custom gerechtfertigt.

Haben wir hochwertige proprietäre Daten (oder können wir sie erheben)? Custom-Modelle sind nur so gut wie ihre Trainingsdaten. Verfügen Sie über Jahre historischer Entscheidungen, Transaktionen oder Sensordaten, die Wettbewerber nicht haben, schöpft Custom-KI diese Assets aus. Ohne proprietäre Daten trainieren Sie nur erneut auf Public-Datasets, die Anbieter ohnehin nutzen.

Gibt es strikte Compliance- oder Latenzanforderungen? Verlangen Regularien bestimmte Datenresidenz, Auditfähigkeit oder Governance – oder benötigen Sie Antwortzeiten unter 100 ms, die SaaS-APIs nicht garantieren –, ist Custom-Deployment nötig.

Wird die Nutzung in 2–3 Jahren signifikant skalieren? Die Ökonomie von Custom verbessert sich mit dem Scale. Erwarten Sie 3–5× Wachstum bei Nutzern, Transaktionen oder Use Cases, wird eigene Infrastruktur langfristig kosteneffizienter.

Bewerten Sie jeden Faktor mit niedrig, mittel, hoch. Hohe Scores über mehrere Dimensionen sind starke Kandidaten für Custom. Niedrige Scores sprechen für Tools von der Stange. Gemischte Scores deuten auf Hybrid hin.

Konkrete Beispiele verdeutlichen das: Support-FAQs? Meist von der Stange oder Hybrid – ausgereift und selten differenzierend. Finanzrisikomodelle auf proprietären Transaktionsdaten? Häufig Custom – Präzisionsgewinne wirken direkt auf die GuV. Mehrsprachige Dokumentenintelligenz in regulierten Kontexten? Meist Custom oder Hybrid – Anforderungen übersteigen generische Tools.

Bereichsübergreifende Beteiligung ist entscheidend. Entscheidungen zu maßgeschneiderter KI betreffen Product, Operations, Security, Legal und Finance. Beschlüsse ohne Blick auf reale Constraints – Integration, Compliance, Budgetzyklen – scheitern oft in der Umsetzung.

Custom-KI ist kein Technik-Luxus. Sie ist dort gerechtfertigt, wo Präzision, Kontrolle und Skalierbarkeit direkt in strategische Ergebnisse einzahlen. Wo das nicht zutrifft, leisten Tools von der Stange hervorragende Dienste.

Vom Konzept in die Produktion: Maßgeschneiderte KI, die wirklich skaliert

Custom-KI schlägt Tools von der Stange nur, wenn sie von Tag eins mit Produktions-Mindset gebaut wird. Der Friedhof der KI-Initiativen ist voll von Prototypen, die bei echten Nutzern, echten Datenvolumina und echten Prozessen scheiterten.

Die Phasen folgen einem Muster:

Discovery und Problemdefinition: Konkretes Business-Problem, Erfolgsmessung, Constraints definieren. Keine vagen Ziele wie „KI zur Prozessverbesserung“, sondern „manuelle Prüfzeit für Claims um 40 % senken bei gleichbleibender Genauigkeit“.

Datenbewertung und -aufbereitung: Datenquellen auf Qualität, Abdeckung, Zugänglichkeit prüfen. Oft zeigt sich: Datenarbeit übersteigt Erwartungen. 2024–2026 entfielen 60–70 % des Aufwands auf Data Readiness – nicht auf Modeling.

Model Design: Geeignete Architekturen und Ansätze wählen – Fine-Tuning von Foundation Models, spezialisierte Klassifikatoren, mehrstufige Pipelines mit Retrieval, Reasoning und Generation.

Pilot/MVP: Funktionsfähiges System im engen Scope – eine Produktlinie, eine Region, ein Nutzer-Subset – bauen, Annahmen validieren, bevor skaliert wird.

Integration in Live-Workflows: An Produktionsdaten, UIs und Business-Prozesse anbinden. Hier scheitern viele – Integrationsaufwand wird oft unterschätzt.

Monitoring und iterative Verbesserung: Monitoring für Modellperformance, Data Drift, Nutzerfeedback. Retrain-Zyklen und kontinuierliche Verbesserung etablieren.

Strenge Datensammlung und -aufbereitung sind zentral. Oft passiert die wichtigste Arbeit vor dem ersten Training – Historik säubern, Inkonsistenzen lösen, Labeling-Standards setzen, tragfähige Pipelines aufbauen.

MLOps-Praktiken sind essenziell, um Performance zu halten: automatisierte Trainingspipelines, CI/CD für Deployments, Drift-Monitoring, geplante Retrainings.

Cross-funktionale Teams aus Domänenexperten, Data Scientists, ML Engineers und Change-Management erzielen bessere Ergebnisse als rein technische Teams. Domänenexperten geben Kontext, Engineers sorgen für Skalierung und Integration, Change-Management treibt Adoption.

Erfolgreiche Organisationen starten meist mit einem High-Impact-Use-Case, liefern binnen sechs bis zwölf Wochen sichtbaren Wert und skalieren dann Plattform und Praxis in weitere Domänen. Das erste Projekt schafft Fähigkeit und Glaubwürdigkeit; die nächsten profitieren davon.

Praktische Umsetzungstipps für 2026

Starten Sie fokussiert und klar abgegrenzt. Wählen Sie ein Problem mit vorhandenen Qualitätsdaten und klaren KPIs. „Manuelle Prüfzeit für Kategorie-X-Claims um Y % senken“ ist besser als „Claims verbessern“. Je enger der Scope, desto schneller zeigen Sie langfristigen Wert und bauen Vertrauen auf.

Nutzen Sie vorhandene Foundation Models und Open-Source-Komponenten. Bauen Sie nicht alles neu. Fine-tunen Sie etablierte Modelle. Setzen Sie auf Open-Source-Embeddings, Vector Databases und Evaluationsframeworks. Ihr Mehrwert steckt in Daten und Domänenlogik – nicht im Neuerfinden von Commodity-Infrastruktur.

Budgetieren Sie den Betrieb nach dem Go-live. Custom-KI ist kein Einmalprojekt. Planen Sie Mittel und Team für Betrieb: Monitoring, Retraining, Security-Reviews, Feature-Ausbau. Rechnen Sie mit quartalsweisen Trainingsupdates oder nach Bedarf.

Bauen Sie interne KI-Kompetenz auf. Schulen Sie Business-Teams, Outputs zu verstehen, Grenzen zu erkennen und Feedback zu geben. Adoption steigt, wenn Nutzer lernen, mit KI zu arbeiten – nicht nur sie zu konsumieren.

Dokumentieren Sie fortlaufend. Halten Sie Data Lineage, Modellversionen, Feature-Definitionen und Entscheidungsschwellen sauber fest. Das unterstützt Entwicklung und Regulierung.

Organisationen, die jetzt – 2024 bis 2026 – in skalierbare Custom-KI investieren, setzen die Messlatte für die nächste Adoptionswelle. Die Custom-KI-Fähigkeiten werden zu sich verstärkenden Assets: Mehr Daten speisen bessere Modelle, die bessere Entscheidungen treiben, die wiederum mehr Daten erzeugen. Dieser Schwungrad-Effekt ist für Spätstarter schwer zu replizieren.

Wer KI als Projekt statt als Fähigkeit betrachtet, kauft weiterhin Tools von der Stange – und bleibt auf Augenhöhe, nie voraus. Wer nachhaltige Wettbewerbsvorteile über Custom-KI aufbaut, definiert den Branchenstandard.

Fazit: Mit Präzision skalieren in der nächsten KI-Welle

Tools von der Stange sind unschätzbar für schnelle Starts, Experimente und Commodities. Doch maßgeschneiderte KI ist der Motor für Präzision, Verteidigbarkeit und langfristigen ROI im Scale. Dieser Unterschied zählt umso mehr, da KI von „interessantem Experiment“ zu „Kerninfrastruktur“ wird.

Custom-KI richtet sich eng an Ihren proprietären Daten, Ihren Systemen, Compliance-Anforderungen und Zielen aus – in einer Tiefe, die generische Lösungen nicht erreichen. Sie passt sich Ihrer Umgebung an, statt Sie den Annahmen eines Vendors zu unterwerfen.

Der nächste Schritt ist klar: Auditieren Sie Ihren aktuellen KI-Stack und identifizieren Sie ein bis zwei High-Value-Use-Cases mit hohem Reibungsverlust, bei denen Custom-KI in den nächsten 12–24 Monaten überproportionale Effekte hebt. Suchen Sie nach Fällen mit einzigartigen Daten, direktem Einfluss von Präzision auf Wachstum oder Compliance-Anforderungen, die Tools von der Stange ausreizen.

Organisationen, die Custom-KI als strategische Fähigkeit – nicht als Nebenprojekt – verstehen, setzen die Standards bis 2026 und darüber hinaus. Die Frage ist nicht, ob Sie KI nutzen. Sondern ob Ihre KI verteidigbare Vorteile schafft, die sich über die Zeit verstärken. Maßgeschneiderte KI, präzise gebaut und diszipliniert skaliert, liefert genau das.

Digital Transformation Strategy for Siemens Finance

Cloud-based platform for Siemens Financial Services in Poland

Das könnte Ihnen auch gefallen...

SH führt MCP-Unterstützung für KI-Integrationen ein

Erfahren Sie, wie SH mit dem Model Context Protocol (MCP) standardisierte KI-Anbindung ermöglicht – für sichere, flexible Integrationen über verschiedene Enterprise-Tools hinweg.

Alexander Stasiak

27. Nov. 2025・10 Min. Lesezeit

Menschenzentrierte KI: Intelligente Produkte gestalten, die Nutzer wirklich gerne verwenden

Im Eifer, KI hastig zu integrieren, verlieren viele Produkte den Nutzer aus dem Blick. Menschenzentrierte KI dreht sich nicht um bloße Modellleistung, sondern darum, für menschliche Ziele, Vertrauen und die Erweiterung menschlicher Fähigkeiten zu gestalten. Erfahren Sie, wie sich die Kluft zwischen „magischen“ Demos und echtem Alltagsnutzen schließen lässt.

Alexander Stasiak

14. März 2026・11 Min. Lesezeit

Warum die meisten KI-Projekte scheitern (und wie Ihres gelingt)

Jedes Jahr werden Milliarden in KI investiert, doch die meisten Pilotprojekte schaffen es nie in den Produktivbetrieb. Erfolg hängt nicht vom besten Algorithmus ab, sondern davon, die Lücke zwischen einer beeindruckenden Demo und einem produktionsreifen System zu schließen. Hier ist das Framework, mit dem Ihre KI-Initiative zur Ausnahme von der Regel wird.

Alexander Stasiak

10. März 2026・9 Min. Lesezeit

Bereit, Ihr Know-how mit KI zu zentralisieren?

Beginnen Sie ein neues Kapitel im Wissensmanagement – wo der KI-Assistent zum zentralen Pfeiler Ihrer digitalen Support-Erfahrung wird.

Kostenlose Beratung buchenArbeiten Sie mit einem Team, dem erstklassige Unternehmen vertrauen.

Wir entwickeln, was als Nächstes kommt.

Dienste